วิวัฒนาการของการ์ดจอจาก 8-bit จนมาถึง Ray Tracing

การ์ดจอคืออะไรและความสำคัญต่อการเล่นเกม

การ์ดจอ (GPU) คืออุปกรณ์ฮาร์ดแวร์ที่ทำหน้าที่เรนเดอร์กราฟิกและภาพต่าง ๆ ให้ปรากฏบนหน้าจอของเรา มันรับภาระในการประมวลผลงานด้านกราฟิกแทนหน่วยประมวลผลกลาง (CPU) เพื่อให้แสดงผลภาพได้รวดเร็วและราบรื่น โดยเฉพาะในวิดีโอเกมสามมิติยุคใหม่ที่มีความซับซ้อนสูง การ์ดจอที่ดีจะทำให้เกมเมอร์ได้สัมผัสประสบการณ์เล่นเกมที่ลื่นไหลและภาพสวยงามสมจริงมากขึ้น

การ์ดจอมีความสำคัญอย่างยิ่งต่อการเล่นเกมยุคปัจจุบัน เพราะการ์ดจอแบบแยก (dedicated GPU) เป็นหัวใจหลักในการประมวลผลกราฟิกของเกมที่หนักหน่วง หากไม่มีการ์ดจอที่ทรงพลัง เกมที่มีกราฟิกคุณภาพสูงอาจกระตุกหรือเล่นไม่ได้เลย นักเล่นเกมจึงให้ความสนใจกับการพัฒนาของการ์ดจอมาโดยตลอด ตั้งแต่ยุคแรกเริ่มที่กราฟิกยังเป็นเพียงภาพพิกเซลง่าย ๆ จนถึงยุคที่การ์ดจอสามารถแสดงแสงเงาแบบสมจริงด้วยเทคโนโลยี Ray Tracing ในปัจจุบัน

การ์ดจอยุค 8-bit และ 16-bit – การเริ่มต้นของกราฟิกในวิดีโอเกม

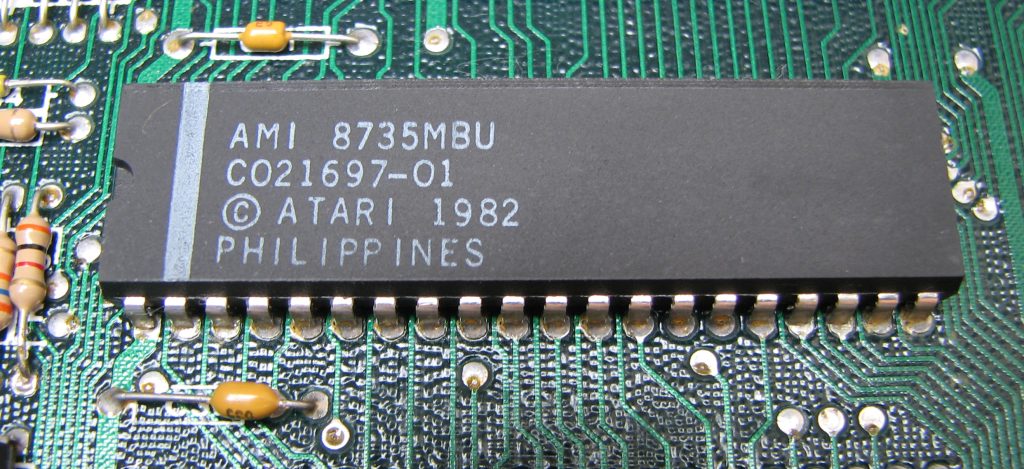

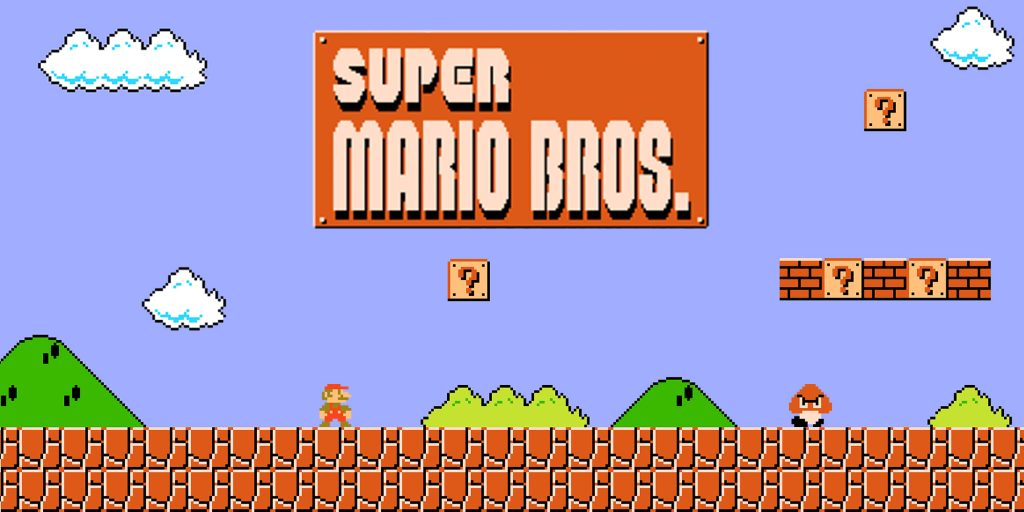

ยุค 8-bit เป็นจุดเริ่มต้นของกราฟิกในวิดีโอเกมที่มีลักษณะเรียบง่าย แต่เต็มไปด้วยความคิดสร้างสรรค์ เกมยุคปลายปี 1970 ถึงต้นปี 1980 มักใช้กราฟิกแบบพิกเซลที่ความละเอียดต่ำ และสีที่จำกัดเพียง 4 ถึง 16 สีเท่านั้น ตัวละครและฉากหลังในเกมอย่าง Space Invaders และ Pac-Man ถูกสร้างขึ้นจากจุดพิกเซลหยาบ ๆ แต่ถึงแม้จะมีข้อจำกัดด้านฮาร์ดแวร์ นักพัฒนาเกมก็สามารถออกแบบรูปทรงและตัวละครให้น่าจดจำได้อย่างน่าทึ่ง โลกของเกมยุค 8-bit อาจดูง่าย ๆ แต่ก็วางรากฐานให้กับวงการเกมและจุดประกายจินตนาการของผู้เล่นหลายล้านคน

ต่อมาในยุค 16-bit (ช่วงปลายทศวรรษ 1980 ถึงต้น 1990) กราฟิกของวิดีโอเกมพัฒนาไปอีกขั้น เครื่องเกมอย่าง Super Nintendo Entertainment System (SNES) และ Sega Genesis ช่วยนำยุคนี้ให้เฟื่องฟู ด้วยความสามารถในการแสดงผลสีได้มากขึ้น (สูงสุดถึง 256 สีบนหน้าจอพร้อมกัน) การมีสีที่หลากหลายขึ้นและความละเอียดที่สูงขึ้นทำให้ตัวละครและฉากในเกมมีรายละเอียดและชีวิตชีวามากกว่าเดิม ยิ่งไปกว่านั้น เทคนิครับภาพแบบ parallax scrolling (การเลื่อนฉากหลายชั้น) เริ่มถูกนำมาใช้ เพื่อสร้างมิติความลึกในเกม 2D ให้ผู้เล่นรู้สึกว่าโลกของเกมมีมิติและการเคลื่อนไหวที่สมจริงขึ้น

เกมดังยุค 16-bit เช่น Sonic the Hedgehog และ Super Mario World แสดงให้เห็นถึงพัฒนาการด้านกราฟิกที่ก้าวกระโดด ด้วยภาพเคลื่อนไหวที่ลื่นไหลและงานศิลป์ของตัวละครที่ละเอียดขึ้น ยุคนี้ยังเกิดแนวเกมที่ซับซ้อนมากขึ้น เช่น เกมแนว RPG อย่าง Chrono Trigger ที่มีโลกและตัวละครที่ประณีตสวยงาม ซึ่งผลักดันขีดจำกัดของกราฟิก 16-bit ไปถึงขอบเขตสูงสุดของยุคนั้น

การมาของ 3D Acceleration และ DirectX/OpenGL ในยุค 1990s

ช่วงกลางทศวรรษ 1990 วงการเกมได้เปลี่ยนโฉมเข้าสู่ยุคสามมิติอย่างเต็มตัว ความนิยมของเกม 3D เพิ่มสูงขึ้นอย่างรวดเร็วจากผลงานบุกเบิกอย่าง Doom และ Quake บนเครื่องพีซี ซึ่งนำเสนอการเล่นเกมในมุมมองบุคคลที่หนึ่งในสิ่งแวดล้อมแบบสามมิติที่ไม่เคยมีมาก่อน ในฝั่งเครื่องคอนโซล เกมคอนโซลยุคที่ห้าอย่าง Sony PlayStation และ Nintendo 64 ก็ได้นำกราฟิก 3D มาสู่ผู้เล่นวงกว้าง ทำให้ผู้เล่นยุคนั้นได้สัมผัสประสบการณ์โลกสามมิติเป็นครั้งแรก การแสดงผลแบบ 3D นี้มาพร้อมแนวคิดใหม่ ๆ เช่น การทำเท็กซ์เจอร์แมปปิ้ง (นำภาพไปแปะบนโมเดล 3D เพื่อเพิ่มรายละเอียดพื้นผิว) และการใช้รูปหลายเหลี่ยม (polygon) สร้างตัวละครและฉาก แทนที่การใช้สไปรต์ 2D แบบเก่าๆ ซึ่งทั้งหมดนี้ช่วยให้กราฟิกเกมสมจริงขึ้นอย่างก้าวกระโดด

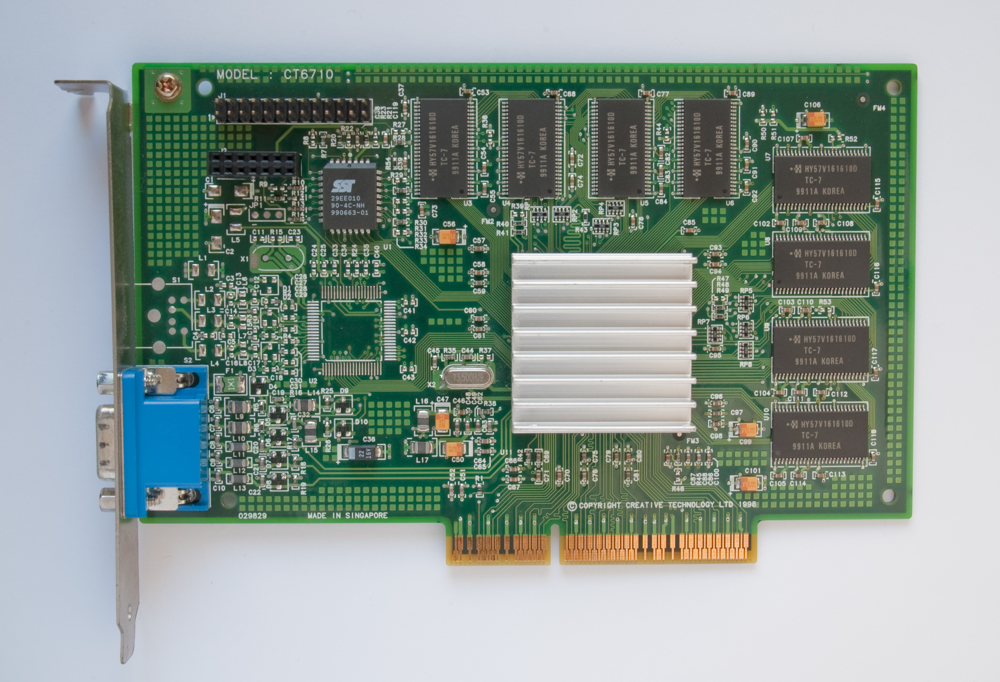

เพื่อรองรับความต้องการด้านกราฟิก 3D ที่เพิ่มขึ้น การ์ดเร่งความเร็วสามมิติ (3D accelerator) แบบแยกเริ่มถือกำเนิดขึ้นในตลาดพีซี การ์ดเหล่านี้เป็นอุปกรณ์เพิ่มเติมที่ติดตั้งลงในเครื่องคอมพิวเตอร์เพื่อประมวลผลกราฟิก 3D โดยเฉพาะ ตัวอย่างแรก ๆ ที่เป็นที่รู้จักคือการ์ดตระกูล 3dfx Voodoo ในปี 1996 ซึ่งสามารถเรนเดอร์ภาพ 3D ได้ลื่นไหลกว่าเดิมมาก แต่การ์ด Voodoo รุ่นแรก ๆ นั้นยังไม่มีความสามารถด้านกราฟิก 2D เลย กล่าวคือมันต้องใช้ควบคู่กับการ์ดจอ 2D แบบเดิมสำหรับการแสดงผลทั่วไปบนวินโดวส์ นอกจาก 3dfx แล้ว บริษัทรายอื่นก็พยายามเข้าสู่ตลาด 3D เช่นกัน เช่น S3 (ViRGE), ATI (Rage) และ Matrox (Mystique) ที่ออกชิปกราฟิกซึ่งเพิ่มฟีเจอร์ 3D เข้าไปบนการ์ด 2D เดิมของตน แม้บางรุ่นจะยังทำผลงานได้ไม่ดีนักในช่วงแรก ๆ

ช่วงเวลาเดียวกันนั้น ซอฟต์แวร์และไดรเวอร์สำหรับกราฟิก 3D ก็มีความสำคัญไม่แพ้กัน OpenGL ซึ่งพัฒนาโดย SGI เปิดตัวในช่วงต้นยุค 90 สำหรับงานกราฟิกระดับมืออาชีพ ขณะที่ฝั่งไมโครซอฟท์ก็พัฒนา DirectX ขึ้นมาเพื่อตอบโจทย์การเล่นเกมบนเครื่องพีซีที่ใช้ระบบปฏิบัติการ Windows โดย DirectX เวอร์ชันแรกออกมาในปี 1995 และมีการเพิ่ม Direct3D ในปี 1996 เพื่อเป็นมาตรฐานกลางให้นักพัฒนาสามารถเรียกใช้งานความสามารถ 3D ของการ์ดจอต่าง ๆ ได้ง่ายขึ้น การมาของ DirectX/Direct3D ทำให้เกมบนแพลตฟอร์ม Windows 95 เป็นต้นมาสามารถใช้ประโยชน์จากการ์ดเร่งกราฟิก 3D ได้อย่างเต็มที่ เปิดประตูสู่ยุคเกมพีซีสามมิติที่เฟื่องฟู

ปลายทศวรรษ 1990 การ์ดจอเริ่มรวมความสามารถ 2D/3D ไว้ในอุปกรณ์เดียวเพื่อความสะดวกและประสิทธิภาพที่ดียิ่งขึ้น ตัวอย่างที่โดดเด่นคือ NVIDIA RIVA TNT ซึ่งเปิดตัวในปี 1998 การ์ดรุ่นนี้พัฒนาต่อยอดจาก RIVA 128 รุ่นก่อนหน้า และถูกผลิตออกมาเพื่อแข่งกับ 3Dfx Voodoo2 โดยตรง มันเพิ่มท่อประมวลผลพิกเซลเป็นสองชุด ทำให้เรนเดอร์ภาพได้รวดเร็วขึ้นเกือบเท่าตัวเมื่อเทียบกับชิปรุ่นก่อนหน้า อีกทั้งยังรองรับสีแบบจริง (32-bit true color) และ Z-buffer 24 บิต ซึ่งช่วยให้ภาพสามมิติที่ได้มีความละเอียดและลุ่มลึกยิ่งขึ้น การมาของ RIVA TNT ทำให้ NVIDIA ได้รับการยอมรับว่าเป็นคู่แข่งที่สูสีกับ 3Dfx ในวงการกราฟิก 3D สำหรับผู้บริโภคทั่วไปอย่างเต็มตัว กล่าวได้ว่าช่วงปลายยุค 90 นั้นเป็นการเริ่มศึกการแข่งขันระหว่างผู้ผลิตการ์ดจอ (อย่าง NVIDIA กับ ATI) ที่จะดำเนินต่อมาอีกหลายทศวรรษข้างหน้า

การพัฒนาการ์ดจอในยุค 2000s – Shader Model และ GPU ที่ทรงพลังขึ้น

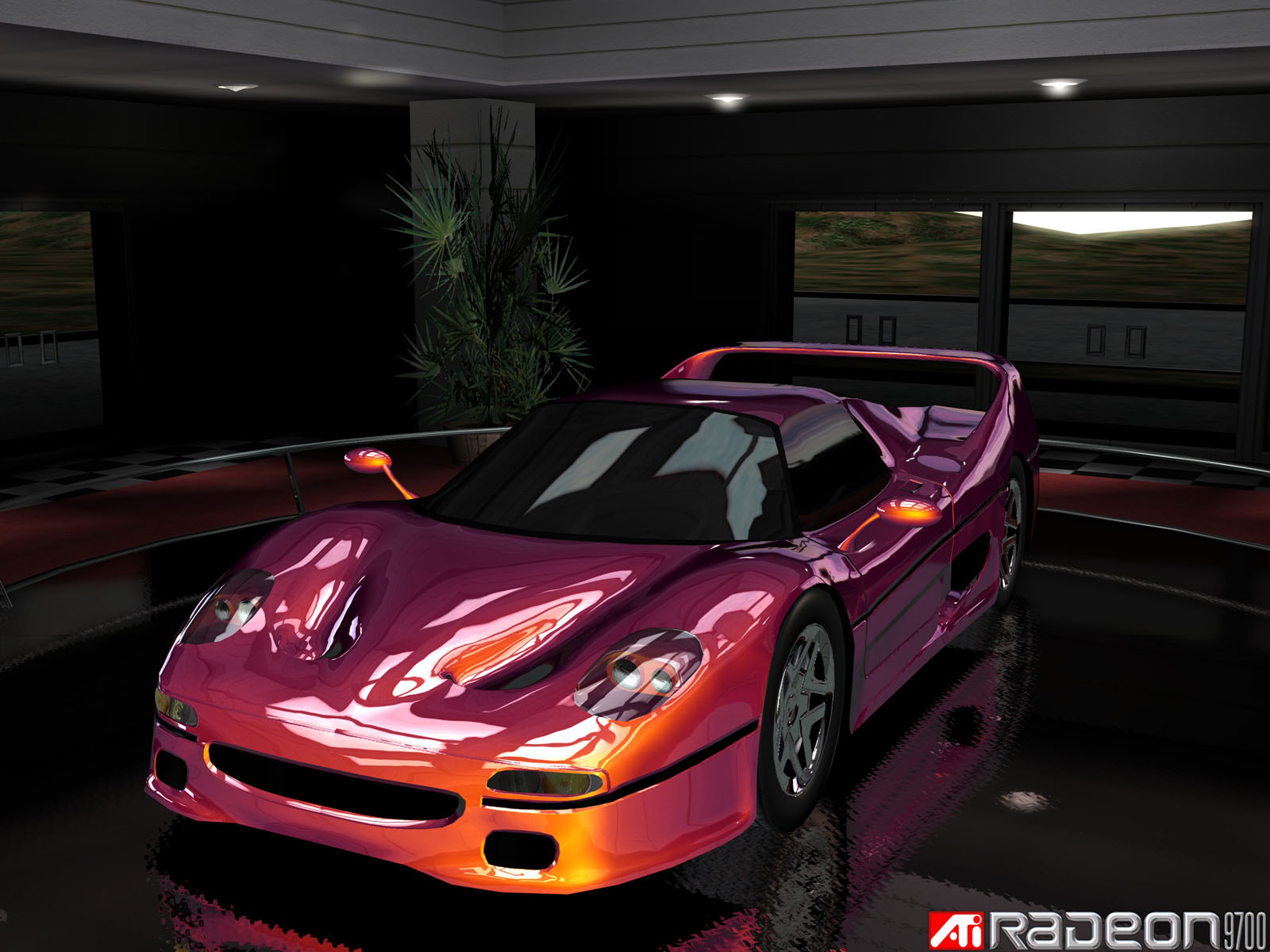

ก้าวเข้าสู่ ยุค 2000s การ์ดจอได้พัฒนาขึ้นอย่างรวดเร็วทั้งในด้านฮาร์ดแวร์และสถาปัตยกรรมการประมวลผล ช่วงต้นยุค 2000 มีการเปิดตัวเทคโนโลยี โปรแกรมเชดเดอร์ (Programmable Shader) บนการ์ดจอเป็นครั้งแรก ทำให้นักพัฒนาสามารถเขียนโค้ดกำหนดลักษณะการแสดงผลของพิกเซลและจุดยอด (vertex) ได้เอง แทนที่จะใช้ชุดความสามารถตายตัวของฮาร์ดแวร์เพียงอย่างเดียว การ์ดจอรุ่น GeForce 3 ของ NVIDIA (เปิดตัวปี 2001) เป็นหนึ่งในรุ่นบุกเบิกที่รองรับการโปรแกรมเชดเดอร์ และถูกนำไปใช้ในเครื่องเล่นเกม Xbox รุ่นแรกด้วย การมี Shader Model รุ่นใหม่ ๆ (เช่น DirectX 8 และ 9) หมายความว่านักพัฒนาสามารถสร้างเอฟเฟ็กต์กราฟิกที่ซับซ้อนขึ้น เช่น แสงเงาที่สมจริง เงาสะท้อนบนพื้นผิว หรือเอฟเฟ็กต์พื้นผิวขรุขระอย่าง bump mapping ซึ่งช่วยให้วัตถุในเกมดูมีมิติความนูนลึกมากขึ้นบนพื้นผิวเรียบๆ ตัวอย่างเช่น ATI Radeon 9700 (R300) ซึ่งเปิดตัวปี 2002 ในฐานะการ์ดจอรุ่นแรกที่รองรับ DirectX 9.0 สามารถประมวลผล shader ที่ซับซ้อนและยาวขึ้น รวมถึงการคำนวณเลขทศนิยมแบบ 32 บิต ทำให้ภาพเกมยุคนั้นสวยสมจริงขึ้นไปอีกขั้น

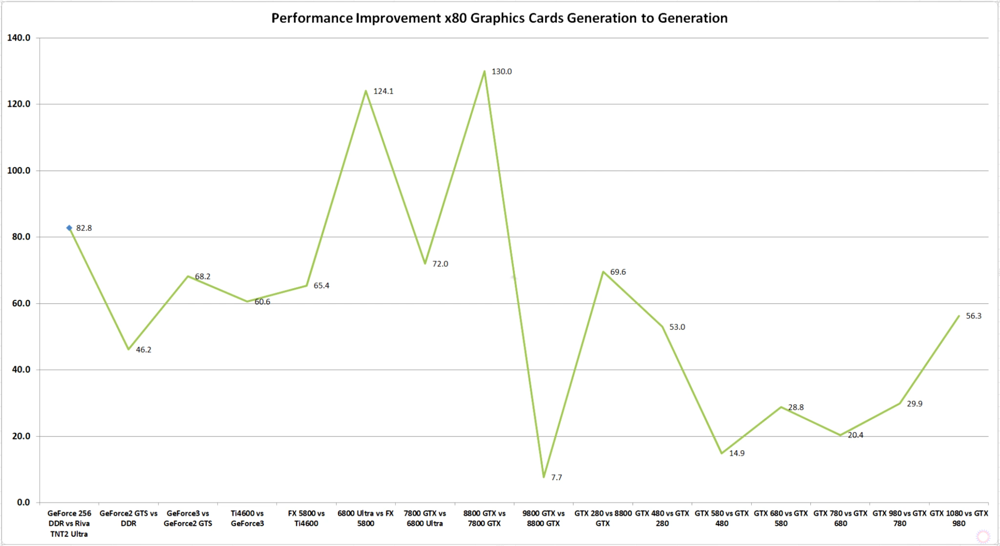

นอกจากความสามารถใหม่ ๆ แล้ว พลังประมวลผลของการ์ดจอในยุค 2000s ก็เพิ่มขึ้นแบบก้าวกระโดดในแทบทุกปี การ์ดจอรุ่นใหม่มักแรงกว่ารุ่นก่อนหน้ามาก ในยุคก่อนปี 2010 ผู้เล่นสามารถคาดหวังว่าการ์ดจอระดับท็อปรุ่นใหม่จะแรงขึ้นเฉลี่ยราว ๆ 70% เมื่อเทียบกับรุ่นก่อนหน้าเลยทีเดียว (บางรุ่นพุ่งขึ้นกว่า 100% ในชั่วข้ามรุ่น เช่น GeForce 6800 Ultra ที่แรงกว่ารุ่นก่อนหน้ากว่าเท่าตัว) อย่างไรก็ตาม หลังปี 2010 เป็นต้นมา อัตราการเพิ่มของประสิทธิภาพต่อรุ่นเริ่มชะลอตัวลงบ้าง ส่วนต่างความแรงระหว่างรุ่นใหม่กับรุ่นเก่าลดลงมาอยู่ราว 30-50% โดยเฉลี่ย เนื่องจากข้อจำกัดด้านกระบวนการผลิตและการแข่งขันที่ลดความร้อนแรงลงในตลาด

ความก้าวหน้าทางเทคโนโลยีการผลิตและสถาปัตยกรรม GPU ในยุค 2000s ส่งผลให้กราฟิกการ์ดมีประสิทธิภาพสูงขึ้นอย่างมากตามกราฟที่แสดงด้านบน ก่อนปี 2010 การ์ดจอรุ่นท็อปแต่ละรุ่นมักจะสร้าง “ก้าวกระโดด” ครั้งใหญ่เมื่อเทียบกับรุ่นก่อนหน้า (บางครั้งเพิ่มขึ้นเกิน 100% ในแง่ประสิทธิภาพ) แต่หลังจากนั้นเป็นต้นมา อัตราการพัฒนาเริ่มชะลอลงบ้าง เหตุผลส่วนหนึ่งมาจากการที่คู่แข่งในตลาดลดน้อยลง (เช่น การที่ NVIDIA ครองตลาดเหนือ AMD อย่างชัดเจน) ทำให้แรงจูงใจในการออกรุ่นใหม่ที่แรงกว่าเดิมแบบก้าวกระโดดลดลงตามไปด้วย อย่างไรก็ตาม แม้อัตราการเพิ่มประสิทธิภาพต่อรุ่นจะลดลง การ์ดจอรุ่นใหม่ยุคหลัง 2010 ก็ยังคงมีความสำคัญในการนำฟีเจอร์ล้ำ ๆ อย่างการประหยัดพลังงานที่ดีขึ้น และเทคโนโลยีการแสดงผลใหม่ ๆ เข้ามาด้วย

ช่วงปลายยุค 2000s ยังได้เห็นการเปลี่ยนแปลงสถาปัตยกรรมภายในของ GPU ครั้งใหญ่ เช่น การเปิดตัว Unified Shader Model ที่รวมหน่วยประมวลผล Shader ให้ทำงานได้ทุกประเภทแทนที่การแยกส่วนเฉพาะทาง ซึ่งถูกนำมาใช้ใน NVIDIA GeForce 8 Series ปี 2006 เป็นต้นไป ทำให้การ์ดจอกลายเป็นหน่วยประมวลผลอเนกประสงค์มากขึ้น และนำไปสู่แนวคิด GPGPU คือการใช้ GPU เพื่อประมวลผลงานทั่วไปที่ไม่ใช่กราฟิก เช่น งานคำนวณทางวิทยาศาสตร์ การสำรวจน้ำมัน หรือการคำนวณทางการเงิน แม้งานเหล่านี้จะไกลตัวเกมเมอร์ทั่วไป แต่ก็เป็นสัญญาณว่า GPU ได้วิวัฒนาการจากการ์ดกราฟิกธรรมดา ๆ กลายเป็นหน่วยประมวลผลทรงพลังที่มีบทบาทในวงการคอมพิวเตอร์โดยรวม ไม่ใช่แค่การเล่นเกมเท่านั้น

การมาของ Ray Tracing และ DLSS – เปลี่ยนโฉมการเรนเดอร์เกมในปัจจุบัน

ในช่วงปลายยุค 2010s การ์ดจอได้เข้าสู่ยุคใหม่อีกครั้งด้วยการรองรับเทคนิคการเรนเดอร์ขั้นสูงอย่าง Ray Tracing แบบเรียลไทม์ Ray Tracing คือเทคนิคการกราฟิกที่จำลองพฤติกรรมของแสงตามหลักฟิสิกส์จริง ๆ โดยการติดตามเส้นทางของรังสีแสงที่สะท้อนและหักเหในฉาก 3D ซึ่งช่วยให้ได้ภาพที่มีความสมจริงสูงมาก เอฟเฟ็กต์ที่ได้รวมถึงเงาที่นุ่มนวลถูกต้องตามแหล่งกำเนิดแสง, เงาสะท้อนบนพื้นผิววัตถุหรือพื้นน้ำที่เหมือนจริง, การกระจายแสงแบบ Global Illumination ที่ทำให้แสงไฟส่งผลถึงกันในทุกวัตถุ ฯลฯ ก่อนหน้านี้ Ray Tracing ถูกใช้ในการเรนเดอร์ภาพยนตร์หรือแอนิเมชันที่ไม่เรียลไทม์ ซึ่งต้องอาศัยเวลาประมวลผลนาน ๆ แต่ไม่มีใช้ในเกมมากนักเพราะฮาร์ดแวร์ยังไม่แรงพอ จนกระทั่ง ปี 2018 NVIDIA ได้เปิดตัวการ์ดจอ GeForce RTX 20-Series (สถาปัตยกรรม Turing) ซึ่งเป็นรุ่นแรกที่มี แกนประมวลผลพิเศษสำหรับ Ray Tracing โดยเฉพาะ ทำให้สามารถประมวลผลแสงเงาแบบ Ray Tracing ได้แบบเรียลไทม์ในเกม และนับเป็นก้าวสำคัญในการยกระดับคุณภาพแสงเงาของกราฟิกเกม ปัจจุบันไม่เพียง NVIDIA เท่านั้นที่มีเทคโนโลยีนี้ การ์ดจอรุ่นใหม่ของ AMD (เช่นตระกูล Radeon RX 6000 Series เป็นต้นไป) ก็รองรับ Ray Tracing ด้วยฮาร์ดแวร์เช่นกัน เพื่อให้ผู้เล่นได้สัมผัสประสบการณ์ภาพสมจริงที่สุดในเกมยุคใหม่

ตัวอย่างเกมยุคปัจจุบันที่โชว์ศักยภาพของ Ray Tracing ได้อย่างเด่นชัดคือ Cyberpunk 2077 ในโหมด Ray Tracing: Overdrive ที่เปิดใช้งาน Path Tracing เต็มรูปแบบทั้งเมือง Night City ภาพที่ได้ทำให้ผู้เล่นตะลึงไปกับความสมจริงของแสงไฟริมถนน เงาสะท้อนบนตัวรถและกระจกตึกระฟ้า รวมถึงบรรยากาศยามค่ำคืนที่เสมือนถ่ายด้วยกล้องในโลกจริง อย่างไรก็ตาม การเรนเดอร์แบบ Ray Tracing ดังกล่าวต้องแลกมาด้วยภาระงานมหาศาลบนการ์ดจอ ถึงขั้นที่การ์ดจอรุ่นท็อปในปัจจุบันยังรันได้เพียงเฟรมเรตระดับหนึ่งเท่านั้น ผู้ผลิตเกม Cyberpunk 2077 เองระบุว่าโหมด Overdrive นี้มีไว้สำหรับอนาคต และในปัจจุบันผู้เล่นที่อยากลองต้องมีการ์ดจอระดับสูงอย่าง GeForce RTX 4090 พร้อมด้วยการเปิดใช้เทคนิคเสริมอย่าง DLSS 3 จึงจะได้เฟรมเรตที่ลื่นไหลในความละเอียดสูง นี่แสดงให้เห็นว่าแม้ Ray Tracing จะยกระดับกราฟิกเกมได้มาก แต่ฮาร์ดแวร์และซอฟต์แวร์ก็ต้องพัฒนาไปควบคู่กันเพื่อรองรับการประมวลผลที่หนักหน่วงนี้

ด้วยเหตุนี้เอง NVIDIA จึงพัฒนาเทคโนโลยี DLSS (Deep Learning Super Sampling) ขึ้นมาเพื่อช่วยเพิ่มประสิทธิภาพในการรันเกมที่เปิด Ray Tracing หรือกราฟิกความละเอียดสูงอื่น ๆ DLSS อาศัยความสามารถของปัญญาประดิษฐ์ในการขยายขนาดภาพ (upscale) ให้มีความคมชัดใกล้เคียงความละเอียดสูง โดยที่การ์ดจอเรนเดอร์ภาพจริงในความละเอียดที่ต่ำกว่าแล้วใช้ AI เติมรายละเอียดของภาพให้สมบูรณ์ การ์ดจอตระกูล RTX มีหน่วยประมวลผล Tensor Cores สำหรับงาน AI โดยเฉพาะ ซึ่ง DLSS ได้ใช้ประโยชน์จากส่วนนี้ในการประมวลผลโมเดล deep learning เพื่อคาดเดาภาพความละเอียดสูงจากภาพความละเอียดต่ำแบบเรียลไทม์ กล่าวง่าย ๆ คือ DLSS ทำให้เล่นเกมได้เฟรมเรตสูงขึ้นโดยไม่สูญเสียคุณภาพของภาพมากนัก ยกตัวอย่าง NVIDIA ได้เปิดตัว DLSS ครั้งแรกพร้อมกับการ์ดซีรีส์ RTX 2000 ในปี 2018 และตามมาด้วย DLSS 2.0 ในปี 2020 ที่ปรับปรุงคุณภาพภาพและรองรับกับเกมหลากหลายมากขึ้นโดยไม่ต้องเทรน AI ใหม่สำหรับแต่ละเกมเหมือนรุ่นก่อนหน้า ปัจจุบัน DLSS กลายเป็นฟีเจอร์สามัญสำหรับเกมใหญ่ ๆ บนพีซีที่ช่วยให้ผู้เล่นได้รับทั้งภาพงามตาและความลื่นไหล โดยเฉพาะเมื่อเล่นในความละเอียดสูงเช่น 4K หรือเปิดเอฟเฟ็กต์หนัก ๆ อย่าง Ray Tracing พร้อมกัน

อนาคตของการ์ดจอ – Quantum Computing, AI และแนวโน้มใหม่ ๆ

ในอนาคตอันใกล้ ปัญญาประดิษฐ์ (AI) และการเรียนรู้ของเครื่องจะมีบทบาทอย่างมากต่อวิวัฒนาการของการ์ดจอ เราได้เห็นสัญญาณนี้แล้วจากเทคโนโลยีอย่าง DLSS ที่ใช้ AI เข้ามาช่วยเรนเดอร์กราฟิก รวมถึงการที่การ์ดจอยุคใหม่ ๆ ใส่หน่วยประมวลผล Tensor Cores สำหรับงาน AI โดยเฉพาะ (เช่นในสถาปัตยกรรม NVIDIA Volta และตระกูล RTX ที่ตามมา ซึ่งเพิ่มแกน Tensor เข้ามาเพื่อเร่งการประมวลผล deep learning ) แนวโน้มนี้อาจพัฒนาต่อไปถึงขั้นที่ GPU และ AI Accelerator ผสานการทำงานเข้าด้วยกันอย่างแนบแน่นยิ่งขึ้น การ์ดจอในอนาคตอาจไม่ได้มีแค่แกนประมวลผลกราฟิก แต่รวมถึงแกนประมวลผล AI ที่ช่วยในการจำลองฟิสิกส์ของเกม การสร้างคู่ต่อสู้ (NPC) ที่มีพฤติกรรมชาญฉลาด หรือแม้แต่ช่วยในการสร้างฉากและเนื้อหาเกมแบบ Procedural อย่างสมจริง สิ่งเหล่านี้จะช่วยยกระดับทั้งคุณภาพภาพและประสบการณ์การเล่นเกมไปพร้อม ๆ กัน นอกจากนี้ การ์ดจอยังถูกนำไปใช้ในวงการ AI นอกเหนือจากเกมอย่างแพร่หลาย เนื่องจากสถาปัตยกรรมแบบขนานของมันเหมาะกับการฝึกโมเดล Machine Learning ขนาดใหญ่ งานอย่างการประมวลผลภาพทางการแพทย์หรือรถยนต์ไร้คนขับต่างก็อาศัยพลังของ GPU ทั้งสิ้น จึงเป็นไปได้ว่าการพัฒนาการ์ดจอรุ่นใหม่ ๆ จะคำนึงถึงการใช้งานด้าน AI เหล่านี้ควบคู่ไปด้วย

อีกเทคโนโลยีหนึ่งที่น่าจับตามองในระยะยาวคือ การประมวลผลแบบควอนตัม (Quantum Computing) ซึ่งอาจถือเป็นก้าวกระโดดถัดไปของวงการคอมพิวเตอร์ นักวิชาการบางคนมองว่าในอนาคต QPU (Quantum Processing Unit) อาจกลายมาเป็น “GPU ตัวถัดไป” เลยทีเดียว เนื่องจากคอมพิวเตอร์ควอนตัมสามารถแก้ปัญหาบางประเภทที่คอมพิวเตอร์แบบเดิม (แม้จะมี GPU ก็ตาม) ไม่สามารถแก้ได้อย่างมีประสิทธิภาพ โดยอาศัยหลักการควอนตัมที่ประมวลผลสถานะได้หลาย ๆ สถานะพร้อมกัน อย่างไรก็ตาม ปัจจุบันเทคโนโลยีควอนตัมยังอยู่ในช่วงเริ่มต้นและต้องใช้ทรัพยากรขนาดใหญ่ (มีใช้งานในห้องแลปหรือซูเปอร์คอมพิวเตอร์เท่านั้น) ยังไม่ใกล้เคียงที่จะนำมาใช้กับการเล่นเกมทั่วไปได้ แต่ในอนาคตระยะยาว หากการประมวลผลควอนตัมพัฒนาไปไกลพอ เราอาจได้เห็นการ์ดจอที่ผสานเทคโนโลยีควอนตัมในการประมวลผลบางส่วน หรือการประมวลผลกราฟิกอาจถูกแทนที่ด้วยแนวคิดใหม่ ๆ ที่พลิกโฉมไปเลยก็เป็นได้

แนวโน้มอื่น ๆ ที่น่าสนใจรวมถึงการพัฒนาการ์ดจอให้มีประสิทธิภาพต่อพลังงานดีขึ้น (Performance per watt สูงขึ้น) เพื่อรองรับการประมวลผลในศูนย์ข้อมูลคลาวด์และอุปกรณ์พกพา, การออกแบบชิปแบบใหม่อย่างการต่อชิปหลายตัว (Chiplet) ใน GPU เพื่อเพิ่มกำลังและลดความร้อน, รวมถึงการรองรับแพลตฟอร์มใหม่ ๆ เช่น Cloud Gaming ที่ผู้เล่นไม่ต้องมีการ์ดจอแรง ๆ ที่บ้านแต่ใช้งานการ์ดจอบนคลาวด์ผ่านอินเทอร์เน็ต เป็นต้น โลกของกราฟิกและการ์ดจอยังคงพัฒนาอย่างต่อเนื่องไม่หยุดนิ่ง จากจุดเริ่มต้นเล็ก ๆ ในยุค 8-bit มาจนถึงปัจจุบันที่เราใกล้เคียงภาพยนตร์เข้าไปทุกที และในอนาคตไม่ว่าเทคโนโลยีใดจะเข้ามาแทนที่หรือเสริมกำลัง การ์ดจอก็จะยังคงเป็นฟันเฟืองสำคัญที่ขับเคลื่อนประสบการณ์การเล่นเกมให้ก้าวไปข้างหน้าต่อไปเสมอ